对搜狗实验室的2012搜狐新闻语料进行切分、格式转换(已转为UTF8),从中抽取了11个新闻类别并分文件夹存储,每个txt文件包含600篇新闻。数据大概共54M,可以用于中文分类。

”文本分类 新闻语料 搜狐新闻“ 的搜索结果

本文的实验数据集来源于搜狗实验室中的搜狐新闻 数据,从中提取出用于训练中文词向量的中文语料, 大小约为 4GB 左右.然后选取了10 个类别的新闻数据,分别为体育, 财经, 房产, 家居, 教育, 科技, 时尚, 时政, 游戏...

本文使用word2vec处理搜狐新闻文本数据,并利用LR进行分类预测。

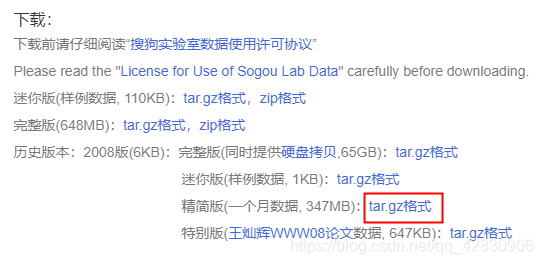

语料库来自于搜狗实验室2008年和2012年的搜狐新闻数据, 下载地址:https://www.sogou.com/labs/resource/cs.php 实验工作主要包括以下几步: 1)语料库的数据预处理; 2)文本建模; 3)训练分类器; 4)对测试集文本...

3000篇搜狐新闻语料数据预处理器的python实现 白宁超 2017年5月5日17:20:04 摘要:关于自然语言处理模型训练亦或是数据挖掘、文本处理等等,均离不开数据清洗,数据预处理的工作。这里的数据不仅仅指狭义上的...

使用了搜狗实验室公开语料集-全网新闻数据(SogouCA),完整语料包含来自若干新闻站点2012年6月—7月期间国内,国际,体育,社会,娱乐等18个频道的新闻数据,提供URL和正文信息。 其格式为: <doc> <url>...

机器学习-基于Word2vec搜狐新闻文本分类实验详解

语料数据来自搜狐新闻2012年6月—7月期间国内,国际,体育,社会,娱乐等18个频道的新闻数据 数据处理参考这篇文章 模型训练: # -*- coding: utf-8-*- from gensim.models.word2vec impor...

数据集来源:... 目的:得到title集合文本,content集合文本 代码: #python2 import chardet with open("news_sohusite_xml.dat",'r') as h: x=h.readlines() # print(x[3]) topi...

基于multinomial-nb的文本分类 文章目录基于multinomial-nb的文本分类一、数据处理1. 数据获取2. 数据预处理二、离散型朴素贝叶斯——multinomial-nb算法1. 文本识别中的NB2. 训练朴素贝叶斯分类器2.1 先验概率P(c)...

一、简介 1)jieba 中文叫做结巴,是一款中文分词工具,https://github.com/fxsjy/jieba 2)word2vec ... ... LogisticRegression中文叫做逻辑回归模型,是一种基础、常用的分类方法 ...

LDA用于文本的主题提取,关于它的理论知识看了很多,现在想在python环境下做一个实践。实践的数据集,英文的主要是希拉里的邮件数据集: 准备工作需要: 1、搭建python 环境 2、pip install gensim 3、安装nltk语言...

搜狐新闻文本分类:机器学习大乱斗

标签: 机器学习

目标从头开始实践中文短文本分类,记录一下实验流程与遇到的坑运用多种机器学习(深度学习 + 传统机器学习)方法比较短文本分类处理过程与结果差别工具深度学习:keras传统机器学习:sklearn参与比较的机器学习方法...

数据来源 https://www.sogou.com/labs/resource/cs.php介绍:来自搜狐新闻2012年6月—7月期间国内,国际,体育,社会,娱乐等18个频道的新闻数据,提供URL和正文信息格式说明:<doc><url>页面URL</...

语料库数据选用搜狗语料库的搜狐新闻数据精简版:http://www.sogou.com/labs/resource/cs.php。 数据集介绍: 来自搜狐新闻2012年6月—7月期间国内,国际,体育,社会,娱乐等18个频道的新闻数据,提供URL和...

中文自然语言处理开放平台 由中国科学院计算技术研究所·数字化室&软件室创立一个研究自然语言处理的一个平台,里面包含有大量的训练测试...文本语料库:http://www.nlp.org.cn/docs/doclist.php?cat_id=16&...

用于文本分类的数据集一般称为语料库。 语料库指经科学取样和加工的大规模电子文本库。借助计算机分析工具,研究者可开展相关的语言理论及应用研究。语料库中存放的是在语言的实际使用中真实出现过的语言材料;...

语料:选择搜狐新闻语料,我选择的是迷你版语料。下载语料地址。 分词:选择结巴分词。参考 模型:word2vec。参考 二、分词 1:安装结巴分词(代码对 Python 2/3 均兼容) 全自动安装:easy_install jieba 或者...

一、语料库链接 下面提供一些网上能下载到的中文...中文新闻分类语料库从凤凰、新浪、网易、腾讯等版面搜集。英语新闻分类语料库为Reuters-21578的ModApte版本。 (2).搜狗的中文新闻语料库 http://www.s

本文将用朴素贝叶斯原理做一个中文文本分类器。朴素贝叶斯完全可以胜任多分类任务。为了方便,这里就先做个2分类的。理论部分:https://blog.csdn.net/montecarlostyle/article/details/79870860 我们事先准备两类...

知乎:https://www.zhihu.com/people/wang-yue-40-21github: https://github.com/wavewangyue目标从头开始实践中...

关于Word2Vec,上篇文章文本分类特征提取之Word2Vec中已有还算详尽的叙述。简单总结下:word2vec是Google在2013年提出的一款开源工具,其是一个Deep Learning模型(实际上该模型层次较浅,严格上还不能算是深层模型...

fasttext原理fasttext提供了一种有效且快速的方式生成词向量以及进行文档分类。fasttext模型输入一个词的序列,输出这个词序列属于不同类别的概率。fasttext模型架构和Word2Vec中的CBOW模型很类似。不同之处在于,...

# fasttext原理fasttext提供了一种有效且快速的方式生成词向量以及进行文档分类。fasttext模型输入一个词的序列,输出这个词序列属于不同类别的概率。fasttext模型架构和Word2Vec中的CBOW模型很类似。不同之处在于,...

文本分类(情感分析)中文数据集汇总 这段时间在公司NLP组里实习,相应的...THUCNews是根据新浪新闻RSS订阅频道2005~2011年间的历史数据筛选过滤生成,包含74万篇新闻文档(2.19 GB),均为UTF-8纯文本格式。我们...

搜狐新闻文本分类数据集 官网https://www.sogou.com/labs/resource/list_news.php 数据集:https://pan.baidu.com/s/1V6o20temK2v3j-bo16x94g提取码:fech 今日头条中文新闻(文本)分类数据集 ...

搜狐新闻文本分类数据集

标签: 文本分类

搜狐新闻文本分类数据集 数据集:https://pan.baidu.com/s/1V6o20temK2v3j-bo16x94g 提取码:fech

推荐文章

- 『Android 技能篇』优雅的转场动画之 Transition-程序员宅基地

- Webshell绕过技巧分析之-base64编码和压缩编码-程序员宅基地

- 大一计算机思维知识点,大学计算机—基于计算思维知识点详解.docx-程序员宅基地

- 关于敏捷开发的一篇访谈录-程序员宅基地

- 挑战安卓和iOS!刚刚,华为官宣鸿蒙手机版,P40搭载演示曝光!高管现场表态:我们准备好了...-程序员宅基地

- 精选了20个Python实战项目(附源码),拿走就用!-程序员宅基地

- android在线图标生成工具,图标在线生成工具Android Asset Studio的使用-程序员宅基地

- android 无限轮播的广告位_轮播广告位-程序员宅基地

- echart省会流向图(物流运输、地图)_java+echart地图+物流跟踪-程序员宅基地

- Ceph源码解析:读写流程_ceph 发送数据到其他副本的源码-程序员宅基地